Tencent Cloud เปิดตัว Xingmai Network 2.0 เร่งโมเดลเทรนนิ่งขนาดใหญ่อีก 20%

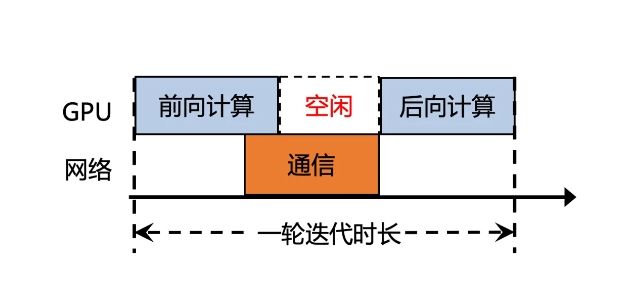

เมื่อเร็วๆ นี้ Tencent Cloud ได้เปิดตัว Xingmai Network 2.0 เวอร์ชันอัปเกรด โดยมีเป้าหมายเพื่อปรับปรุงประสิทธิภาพของการฝึกโมเดลขนาดใหญ่ ในเวอร์ชันก่อนหน้า เวลาการสื่อสารการซิงโครไนซ์ของผลการคำนวณของโมเดลขนาดใหญ่คิดเป็นมากกว่า 50% ส่งผลให้มีประสิทธิภาพต่ำ Xingmai Network 2.0 เวอร์ชันใหม่ได้รับการอัปเกรดในหลายด้าน:

1. รองรับเครือข่าย 100,000 การ์ดในคลัสเตอร์เดียว เพิ่มขนาดเป็นสองเท่า เพิ่มประสิทธิภาพการสื่อสารเครือข่าย 60% เพิ่มประสิทธิภาพการฝึกโมเดลขนาดใหญ่ 20% และลดตำแหน่งข้อผิดพลาดจากวันเหลือเพียงไม่กี่นาที

2. สวิตช์ โมดูลออปติคอล การ์ดเครือข่าย และอุปกรณ์เครือข่ายอื่นๆ ที่พัฒนาขึ้นเอง ได้รับการอัปเกรดเพื่อทำให้โครงสร้างพื้นฐานมีความน่าเชื่อถือมากขึ้น และรองรับคลัสเตอร์เดียวที่มีขนาดการ์ด GPU มากกว่า 100,000 ใบ

3. มีการใช้โปรโตคอลการสื่อสารใหม่ TiTa2.0 บนการ์ดเครือข่าย และอัลกอริธึมความแออัดได้รับการอัพเกรดเป็นอัลกอริธึมควบคุมความแออัดที่ใช้งานอยู่ ประสิทธิภาพการสื่อสารเพิ่มขึ้น 30% และประสิทธิภาพการฝึกอบรมโมเดลขนาดใหญ่เพิ่มขึ้น 10%

4. ไลบรารีการสื่อสารรวมประสิทธิภาพสูง TCCL2.0 ใช้การสื่อสารแบบขนานที่ต่างกันแบบ NVLINK+NET เพื่อให้เกิดการส่งข้อมูลแบบขนาน นอกจากนี้ ยังมีอัลกอริธึมการปรับตัวของผู้เชี่ยวชาญเครือข่ายปรับอัตโนมัติ ซึ่งปรับปรุงประสิทธิภาพการสื่อสารขึ้น 30% และประสิทธิภาพการฝึกโมเดลขนาดใหญ่ด้วย 10%.

5. แพลตฟอร์มจำลอง Lingjing ซึ่งเป็นเทคโนโลยีเอกสิทธิ์เฉพาะของ Tencent ที่เพิ่มเข้ามาใหม่ สามารถตรวจสอบเครือข่ายคลัสเตอร์ได้อย่างเต็มที่ ค้นหาปัญหาโหนด GPU ได้อย่างแม่นยำ และลดเวลาในการค้นหาข้อผิดพลาดในการฝึกอบรมระดับ 10,000-ka จากหลายวันเหลือเพียงนาที

ด้วยการอัปเกรดเหล่านี้ ประสิทธิภาพการสื่อสารของเครือข่าย Xingmai เพิ่มขึ้น 60% ประสิทธิภาพการฝึกโมเดลขนาดใหญ่เพิ่มขึ้น 20% และปรับปรุงความแม่นยำของตำแหน่งข้อผิดพลาดด้วย การปรับปรุงเหล่านี้จะช่วยปรับปรุงประสิทธิภาพและประสิทธิภาพของการฝึกโมเดลขนาดใหญ่ ช่วยให้ทรัพยากร GPU ที่มีราคาแพงสามารถนำไปใช้ประโยชน์ได้อย่างเต็มที่มากขึ้น

-

มันเป็นช่วงเวลาที่น่ากลัวของปีดังนั้นนี่คือเกมสยองขวัญที่ดีที่สุดที่คุณสามารถเล่นเพื่อให้ตัวเองตกใจได้ดี

มันเป็นช่วงเวลาที่น่ากลัวของปีดังนั้นนี่คือเกมสยองขวัญที่ดีที่สุดที่คุณสามารถเล่นเพื่อให้ตัวเองตกใจได้ดี -

ห้องนอนบ้านหลบหนี

แก้ปริศนาทัวร์อพาร์ทเมนต์ Moon House! -

วิธีการเล่นลูกเต๋าในราชอาณาจักรมาช่วย 2: คอมโบป้ายและคะแนนทั้งหมด

หากคุณสงสัยว่าจะเล่นลูกเต๋าในราชอาณาจักรได้อย่างไร: การปลดปล่อย 2 นี่คือสิ่งที่คุณต้องรู้เกี่ยวกับเรื่องนั้น -

วิธีสร้างรถในการสร้างรถเพื่อฆ่าซอมบี้

ซอมบี้แตกตื่น!