تطلق Tencent Cloud شبكة Xingmai Network 2.0 لتسريع تدريب النماذج الكبيرة بنسبة 20% أخرى

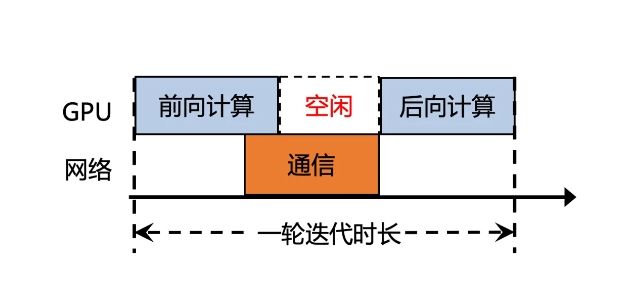

أطلقت Tencent Cloud مؤخرًا نسخة مطورة من Xingmai Network 2.0، بهدف تحسين كفاءة التدريب على النماذج الكبيرة. في الإصدار السابق، كان وقت الاتصال المتزامن لنتائج حساب النماذج الكبيرة يمثل أكثر من 50%، مما أدى إلى انخفاض الكفاءة. تمت ترقية الإصدار الجديد من Xingmai Network 2.0 في العديد من الجوانب:

1. يدعم شبكة مكونة من 100000 بطاقة في مجموعة واحدة، مما يؤدي إلى مضاعفة الحجم وزيادة كفاءة الاتصال بالشبكة بنسبة 60% وزيادة كفاءة تدريب النماذج الكبيرة بنسبة 20% وتقليل موقع الخطأ من أيام إلى دقائق.

2. تتم ترقية المحولات والوحدات الضوئية وبطاقات الشبكة ومعدات الشبكة الأخرى التي تم تطويرها ذاتيًا لجعل البنية التحتية أكثر موثوقية ودعم مجموعة واحدة بمقياس يزيد عن 100000 بطاقة GPU.

3. يتم نشر بروتوكول الاتصال الجديد TiTa2.0 على بطاقة الشبكة، ويتم ترقية خوارزمية الازدحام إلى خوارزمية نشطة للتحكم في الازدحام بنسبة 30%، وتزداد كفاءة تدريب النماذج الكبيرة بنسبة 10%.

4. تستخدم مكتبة الاتصالات الجماعية عالية الأداء TCCL2.0 الاتصال المتوازي غير المتجانس NVLINK+NET لتحقيق النقل المتوازي للبيانات، كما أنها تحتوي على خوارزمية التكيف Auto-Tune Network Expert، والتي تعمل على تحسين أداء الاتصال بنسبة 30% وكفاءة تدريب النماذج الكبيرة بنسبة. 10%.

5. يمكن لمنصة محاكاة Lingjing للتكنولوجيا الحصرية المضافة حديثًا من Tencent مراقبة الشبكة العنقودية بشكل كامل، وتحديد موقع مشكلات عقدة وحدة معالجة الرسومات بدقة، وتقليل الوقت لتحديد أخطاء التدريب على مستوى 10,000 ka من أيام إلى دقائق.

من خلال هذه الترقيات، تمت زيادة كفاءة الاتصال لشبكة Xingmai بنسبة 60%، كما تمت زيادة كفاءة تدريب النماذج الكبيرة بنسبة 20%، كما تم تحسين دقة موقع الخطأ. ستساعد هذه التحسينات على تحسين كفاءة وأداء تدريب النماذج الكبيرة، مما يسمح باستخدام موارد وحدة معالجة الرسومات باهظة الثمن بشكل كامل.

-

إنه الوقت المخيف من العام ، لذا إليك بعضًا من أفضل ألعاب الرعب التي يمكنك لعبها لمنح نفسك تخويفًا جيدًا.

إنه الوقت المخيف من العام ، لذا إليك بعضًا من أفضل ألعاب الرعب التي يمكنك لعبها لمنح نفسك تخويفًا جيدًا. -

القمر منزل الهروب

حل لغز جولة شقة القمر! -

كيف تلعب الزهر في المملكة تأتي الخلاص 2: جميع الشارات ومجموعات التسجيل

إذا كنت تتساءل عن كيفية لعب الزهر في المملكة ، فإن الخلاص 2 ، إليك ما تحتاج إلى معرفته حول ذلك. -

كيف تصنع سيارة في بناء سيارة لقتل الزومبي

Zombie Stampede!