Modelos da série Qwen2.5 de código aberto do Alibaba Tongyi Qianwen: Qwen2-VL-72B é comparável ao GPT-4

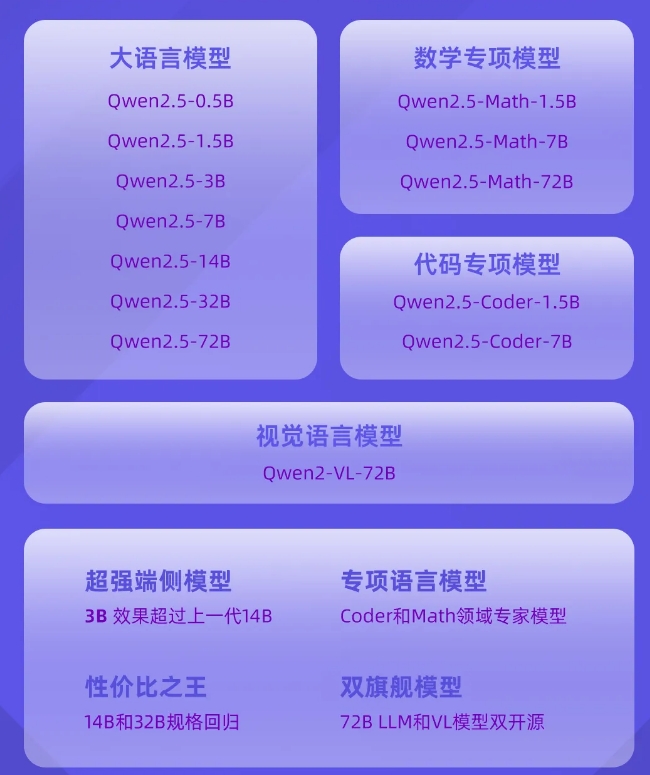

A equipe Tongyi Qianwen anunciou que três meses após o lançamento do Qwen2, o mais recente membro da família Qwen, a série de modelos de linguagem Qwen2.5, é oficialmente de código aberto. Isto marca o que pode ser um dos maiores lançamentos de código aberto da história, incluindo o modelo de linguagem geral Qwen2.5, bem como os modelos Qwen2.5-Coder e Qwen2.5-Math voltados especificamente para os campos de programação e matemática.

Os modelos da série Qwen2.5 são pré-treinados no mais recente conjunto de dados em grande escala, que contém até 18T tokens. Comparado com o Qwen2, o novo modelo melhorou significativamente na aquisição de conhecimento, capacidade de programação e habilidade matemática. O modelo suporta processamento de texto longo, pode gerar conteúdo de até 8K tokens e mantém suporte para mais de 29 idiomas.

Os modelos da série Qwen2.5 de código aberto não apenas adotam a licença Apache2.0, mas também fornecem uma variedade de versões de diferentes tamanhos para se adaptarem às diferentes necessidades de aplicativos. Além disso, a equipe Tongyi Qianwen também abriu o código-fonte do modelo Qwen2-VL-72B com desempenho comparável ao GPT-4.

O novo modelo alcança melhorias significativas na execução de instruções, geração de textos longos, compreensão de dados estruturados e geração de resultados estruturados. Especialmente nas áreas de programação e matemática, os modelos Qwen2.5-Coder e Qwen2.5-Math foram treinados em conjuntos de dados profissionais, demonstrando capacidades mais fortes nas áreas profissionais.

Experiência do modelo da série Qwen2.5:

Coleção Qwen2.5: https://modelscope.cn/studios/qwen/Qwen2.5

-

É a época assustadora do ano, então aqui estão alguns dos melhores jogos de terror que você pode jogar para se dar um bom susto.

É a época assustadora do ano, então aqui estão alguns dos melhores jogos de terror que você pode jogar para se dar um bom susto. -

Lua Sala da sala de fuga Passo a passo

Resolva o quebra -cabeça da turnê do apartamento da lua! -

Como jogar dados no reino vem Deliverance 2: Todos os crachás e combos de pontuação

Se você está se perguntando como tocar dados no reino: Deliverance 2, aqui está o que você precisa saber sobre isso. -

Como fazer um carro para construir um carro para matar zumbis

Zombie Stampede!