Modelos de la serie Qwen2.5 de código abierto de Alibaba Tongyi Qianwen: Qwen2-VL-72B es comparable a GPT-4

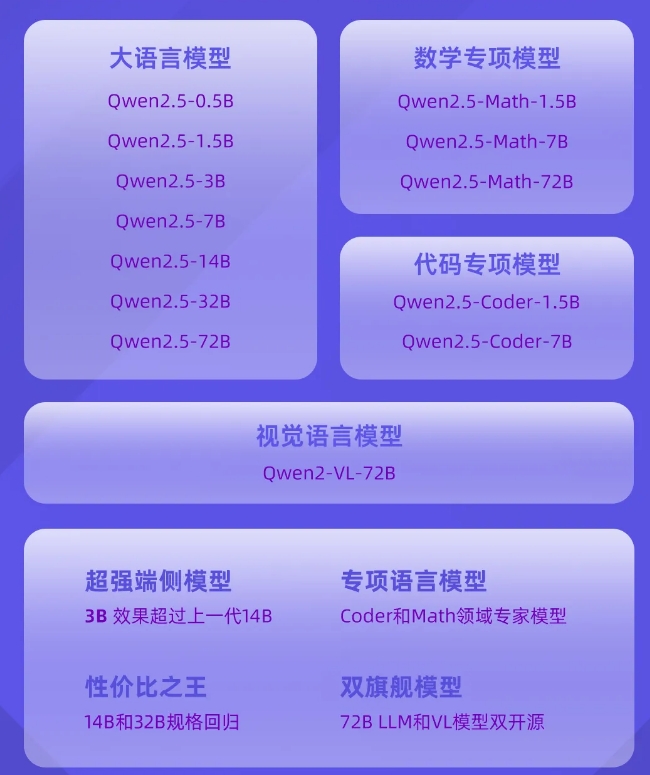

El equipo de Tongyi Qianwen anunció que tres meses después del lanzamiento de Qwen2, el último miembro de la familia Qwen, la serie de modelos de lenguaje Qwen2.5, es oficialmente de código abierto. Esto marca lo que puede ser uno de los lanzamientos de código abierto más grandes de la historia, incluido el modelo de lenguaje general Qwen2.5, así como los modelos Qwen2.5-Coder y Qwen2.5-Math específicamente dirigidos a los campos de programación y matemáticas.

Los modelos de la serie Qwen2.5 están pre-entrenados en el último conjunto de datos a gran escala, que contiene hasta 18T tokens. En comparación con Qwen2, el nuevo modelo ha mejorado significativamente en la adquisición de conocimientos, la capacidad de programación y la capacidad matemática. El modelo admite el procesamiento de textos largos, puede generar contenido de hasta 8K tokens y admite más de 29 idiomas.

Los modelos de la serie Qwen2.5 de código abierto no solo adoptan la licencia Apache2.0, sino que también proporcionan una variedad de versiones de diferentes tamaños para adaptarse a las diferentes necesidades de las aplicaciones. Además, el equipo de Tongyi Qianwen también abrió el modelo Qwen2-VL-72B con un rendimiento comparable al GPT-4.

El nuevo modelo logra mejoras significativas en la ejecución de instrucciones, generación de textos largos, comprensión de datos estructurados y generación de resultados estructurados. Especialmente en los campos de la programación y las matemáticas, los modelos Qwen2.5-Coder y Qwen2.5-Math se entrenaron en conjuntos de datos profesionales, lo que demuestra capacidades más sólidas en los campos profesionales.

Experiencia del modelo de la serie Qwen2.5:

Colección Qwen2.5: https://modelscope.cn/studios/qwen/Qwen2.5

-

Es la época espeluznante del año, así que estos son algunos de los mejores juegos de terror que puedes jugar para darte un buen susto.

Es la época espeluznante del año, así que estos son algunos de los mejores juegos de terror que puedes jugar para darte un buen susto. -

Tutorial de escape de la sala de la casa de la luna

¡Resuelve el rompecabezas del apartamento de la casa de la luna! -

Cómo jugar Dice in Kingdom Come Deliverance 2: Todas las insignias y combos de puntuación

Si te estás preguntando cómo jugar dados en Kingdom Come: Deliverance 2, esto es lo que necesitas saber sobre eso. -

Cómo hacer un auto en construir un automóvil para matar zombis

¡Zombie Stampede!