白嫖黨狂喜! GPT-4o mini免費微調2個月,每天200萬token隨便薅

當Llama3.1開源的消息還在耳邊迴響,OpenAI又來搶風頭了。從現在起,每天200萬訓練token免費微調模型,直到9月23日。這不僅是對開發者的慷慨解囊,更是對AI技術進步的一次大膽推動。

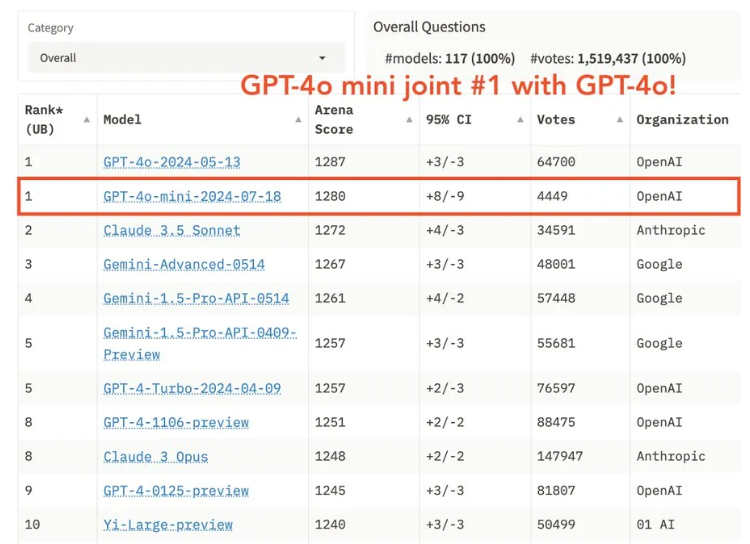

GPT-4o mini的問世,讓無數開發者興奮不已。它在大模型競技場LMSYS排名中與GPT-4o並列第一,性能強悍,但價格只有GPT-4o的1/20。 OpenAI的這項舉措,無疑是對AI領域的一次重大利好。

收到郵件的開發者們激動地奔走相告,這麼大的羊毛一定要趕快薅。 OpenAI宣布,7月23日-9月23日期間,開發者每天可以免費使用200萬訓練token。超過的部分,將會以3美元百萬token收費。

更實惠:GPT-4o mini的輸入Token費用比GPT-3.5Turbo低90%,輸出Tokens費用低80%。即使在免費期結束後,GPT-4o mini的訓練成本也比GPT-3.5Turbo低一半。

較長上下文:GPT-4o mini的訓練上下文長度為65k Token,是GPT-3.5Turbo的4倍,推理上下文長度為128k Token,是GPT-3.5Turbo的8倍。

更聰明且更有能力:GPT-4o mini比GPT-3.5Turbo更聰明,並且支援視覺功能(儘管目前微調僅限於文字)。

GPT-4o mini微調功能將向企業客戶,以及Tier4和Tier5開發者開放,未來將逐漸擴大存取權限,並擴展至所有等級的使用者。 OpenAI已經放出了微調指南,方便開發者快速上手。

有一部分網友對此並不看好,他們認為這是OpenAI在收集數據,訓練和改進AI模型。而其他網友則認為,GPT-4o mini的勝利是一個實質的證據,證明了AI已經變得足夠聰明,甚至可以愚弄我們。

GPT-4o mini的發布和免費微調政策,無疑將推動AI技術的進一步發展和普及。對開發者來說,這是一個千載難逢的機會,能夠以更低的成本,建構更強大的應用。而對於AI科技本身,這是否意味著一個新的里程碑?讓我們拭目以待。

微調文件:https://platform.openai.com/docs/guides/fine-tuning/fine-tuning-integrations

-

這是一年中怪異的時刻,所以這是您可以玩的一些最好的恐怖遊戲,以使自己造成良好的恐懼。

這是一年中怪異的時刻,所以這是您可以玩的一些最好的恐怖遊戲,以使自己造成良好的恐懼。 -

月球房間逃脫演練

解決月球之家公寓之旅難題! -

如何在《王國出現骰子》中演奏骰子2:所有徽章和得分組合

如果您想知道如何在《王國的骰子》中玩骰子:拯救2,這就是您需要知道的。 -

如何在製造汽車殺死殭屍的汽車中

殭屍踩踏!